一、项目背景:AI 时代的“傻瓜式”操作界面

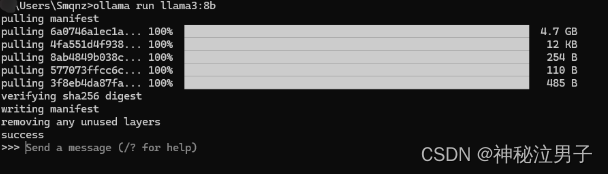

如果你玩过本地部署的大语言模型(比如 LLaMA、Mistral),大概率经历过这样的痛苦:在命令行里输入一堆代码,看着密密麻麻的日志,最后只能在简陋的对话框里打字聊天。而 Open WebUI 就像给这些模型穿上了一件漂亮的外套——它把复杂的 AI 模型变成了一个和 ChatGPT 几乎一模一样的网页聊天工具。

这个开源项目最初叫 Ollama WebUI(名字直白到不用解释),后来因为功能越来越强大,改名为 Open WebUI。如今它在 GitHub 上收获了 7 万多个星标,被网友称为“本地大模型的最佳拍档”。简单来说,它的核心价值就一句话:让普通人也能像用手机 App 一样玩转 AI。

二、核心功能:不止是聊天机器人

很多人第一次打开 Open WebUI 都会惊呼:“这不就是山寨版 ChatGPT 吗?”但它的能耐远不止于此:

多模型随意切换

无论是本地部署的 Ollama 模型(比如 DeepSeek-R1),还是 OpenAI 的付费 API,甚至是 GroqCloud、Mistral 这些第三方服务,都能在一个界面里无缝切换。想象一下:早上用 GPT-4 写工作报告,下午换成国产的 DeepSeek 生成代码,晚上让 Claude 帮你写情书——就像换电视频道一样简单。文档秒变知识库

这里藏着个杀手锏功能:RAG(检索增强生成)。直接把 PDF、TXT 文档拖进聊天框,AI 就能自动学习文件内容。比如上传公司财报后问:“去年净利润增长了多少?”它不会瞎编,而是精准定位数据。更厉害的是支持动态更新知识库,写论文时能边查资料边让 AI 整理文献。AI 全家桶服务

除了聊天,还能画图(集成 DALL-E)、语音对话、网页搜索。最有趣的是“模型竞技场”——让两个 AI 就同一个问题辩论,看谁说得更有道理。这些功能都通过插件实现,技术宅们甚至可以自己开发新玩法。企业级权限管理

管理员可以设置不同用户的权限:实习生只能用基础模型,CTO 能调用所有高级功能;还能记录每个人的聊天记录,防止商业机密泄露。对于想内部部署 AI 的中小企业,这比直接使用 ChatGPT 安全得多。

三、安装教程:5 分钟搞定

别被“自托管”“Docker”这些词吓到,实际操作比装手机 App 还简单:

方案一:Docker 极速版(推荐小白)

在电脑上打开终端,复制粘贴这三行代码:

docker rm -f open-webui docker pull ghcr.io/open-webui/open-webui:main docker run -d -p 3000:8080 -v open-webui:/app/backend/data --name open-webui ghcr.io/open-webui/open-webui:main

打开浏览器访问 http://localhost:3000,注册个账号就能用了。整个过程就像泡一碗方便面——烧水、倒调料、等三分钟。

方案二:Python 开发者版

适合想二次开发的极客:

git clone https://github.com/open-webui/open-webui.git cd open-webui cp .env.example .env npm install npm run dev # 前端跑在 5173 端口 cd backend conda create --name open-webui python=3.11 conda activate open-webui sh dev.sh # 后端跑在 8080 端口

这样就能修改源码了,比如把默认主题色从蓝色改成猛男粉。

四、实战技巧:从菜鸟到高手

连接付费 API 的秘诀

在设置里找到“外部连接”,填入像https://api.cursorai.art/v1这样的代理地址(国内可用),再输入购买的 API Key。建议同时添加多个服务商,避免某家宕机时服务中断。让 AI 帮你写小说

活用 RAG 功能:先上传《三体》电子书,输入指令:“请模仿刘慈欣的风格,续写一段地球舰队与三体人的对话。”对比直接让 GPT-4 瞎编,生成内容明显更有原著味道。移动端适配黑科技

用手机访问时会自动变成 PWA 应用,添加到桌面后和原生 App 几乎没区别。实测在地铁上用 4G 网络也能流畅聊天,适合随时记录灵感。

五、为什么选择它?

和同类产品(比如 LibreChat、AnythingLLM)相比,Open WebUI 有三大优势:

零成本入门:不需要买显卡,老电脑都能跑

数据绝对隐私:聊天记录存在自家硬盘,不怕被第三方审查

生态丰富:官方提供 50+ 插件,从 MidJourney 画图到 Notion 同步应有尽有

有个程序员朋友的真实案例:他用树莓派+Open WebUI 做了个“家庭智能中枢”,早上用语音让 AI 播报天气,下班前远程启动空调,周末教孩子用 RAG 功能写作业——整套系统耗电量还不如一台电风扇。

六、未来展望:人人都能定制 AI

项目团队最近放出了 Pipelines 插件框架,允许用 Python 编写自定义流程。比如开发一个“论文助手”:上传参考文献→AI 自动生成摘要→检查重复率→导出 Word 格式。这种模块化设计,让不会编程的人也能搭积木般创建 AI 应用。

正如开发者所说:“我们不想做另一个 ChatGPT,而是要打造 AI 时代的乐高积木。”在这个平台上,退休教师可以制作历史知识问答机器人,外卖店主能开发自动接单系统,00 后甚至能用它追星——这才是技术普惠的真正意义。

本文由@ai资讯 原创发布。

该文章观点仅代表作者本人,不代表本站立场。本站不承担相关法律责任。

如若转载,请注明出处:https://www.zhanid.com/news/3551.html