一、Orpheus-TTS是什么

Orpheus - TTS是一个开源的文本到语音转换(TTS)系统,它构建于Llama - 3b骨干网络之上。该项目旨在展示大型语言模型(LLM)在语音合成方面的新兴能力。Orpheus - TTS的出现为语音合成领域带来了新的思路和方法,通过利用LLM的特性,试图在语音的自然度、情感表达等多方面取得突破。

二、功能特色

类人语音表现

具有自然的音调、情感和节奏。与现有的顶级闭源模型(如Eleven Labs和PlayHT)相比,在这方面表现出色。它能够生成听起来更加自然流畅的语音,就好像是一个真实的人在说话,而不是机械性的合成语音。

零样本语音克隆

可以在没有预先微调的情况下克隆声音。这一特性在很多场景下非常有用,例如在需要快速生成某个特定人物声音的语音内容时,不需要花费大量时间进行专门的微调过程。

引导情感和语调

通过简单的标签就能够控制语音的情感和语调特征。比如可以使用特定的标签如<laugh>、<chuckle>等来让合成的语音带有相应的情绪色彩,这为语音内容的创作提供了更多的创意空间。

低延迟

对于实时应用,具有约200毫秒的流式传输延迟,并且通过输入流可以将延迟降低到大约100毫秒。这使得它在对延迟要求较高的场景,如实时交互性的虚拟现实(VR)或增强现实(AR)应用中具有一定的优势。

三、技术细节

模型提供与数据处理

项目提供了三个模型。其中包括预训练模型,该模型是在10万 + 小时的英语语音数据上进行训练的。还提供了数据处理脚本和样本数据集,方便用户创建自己的微调模型。

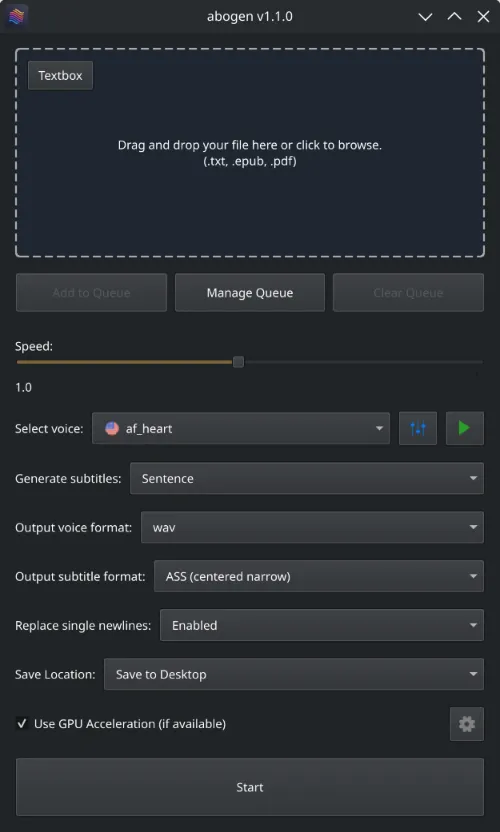

推理过程

在推理方面,对于预训练模型,在Colab环境下有专门的设置。例如,在进行条件生成时,可以按照特定的格式设置提示语。对于微调后的模型(非流式,针对实时流式有不同的情况),也有相应的在Colab中的操作方式。

在代码实现上,以一个简单的示例来看,从导入

OrpheusModel开始,到设置模型的名称、输入的提示语等参数,然后通过generate_speech方法生成语音合成结果。并且在处理音频输出时,涉及到wave库的操作,如设置声道数、采样宽度、帧率等参数,并且计算音频生成的时长等信息。微调过程

微调模型的过程类似于使用Trainer和Transformers对大型语言模型进行微调。一般来说,开始看到高质量结果可能在50个示例左右,但要达到最佳效果,目标是每个说话者300个示例。数据的预处理时间大约每千行不到1分钟。用户需要修改

finetune/config.yaml文件来包含自己的数据集和训练属性,然后运行训练脚本。还可以结合其他兼容Hugging Face的工具如Lora等进行模型的调整。

四、应用场景

内容创作领域

在影视制作中,可以为动画角色配音,由于其零样本语音克隆和引导情感语调的功能,可以快速为不同性格的角色赋予合适的声音,并且使声音带有相应的情感色彩。

在广播剧制作方面,能够根据剧本内容快速生成旁白或者角色的语音,而且可以通过调整参数来营造不同的氛围,如悬疑、喜剧等。

辅助技术方面

对于视障人士的辅助设备开发,其低延迟的特性可以使合成的语音及时反馈给用户,提高用户体验。

在语音助手的开发中,能够提供更加自然的语音输出,使语音助手与用户的交互更加流畅和自然。

教育领域

可以为语言学习者提供标准的语音示范,无论是单词、句子还是篇章的语音合成,都可以帮助学习者更好地掌握发音和语调。

五、相关链接

六、总结

Orpheus - TTS作为一个开源的文本到语音转换系统,以其基于Llama - 3b的创新架构,在语音合成的自然度、情感表达、零样本克隆等方面展现出了独特的优势。它的低延迟特性也为实时应用提供了可能。在技术实现上,无论是模型的提供、推理过程还是微调过程都有较为详细的规划和操作指南。在应用场景方面,涵盖了内容创作、辅助技术和教育等多个领域。随着技术的不断发展,Orpheus - TTS有望在语音合成领域进一步发展,例如通过与更多的外部设备和系统的集成,为用户提供更加丰富的语音合成解决方案。同时,其开源的性质也将吸引更多的开发者参与到项目的改进和拓展中来,不断优化其性能和功能。

本文由@ai资讯 原创发布。

该文章观点仅代表作者本人,不代表本站立场。本站不承担相关法律责任。

如若转载,请注明出处:https://www.zhanid.com/news/3901.html