一、项目介绍

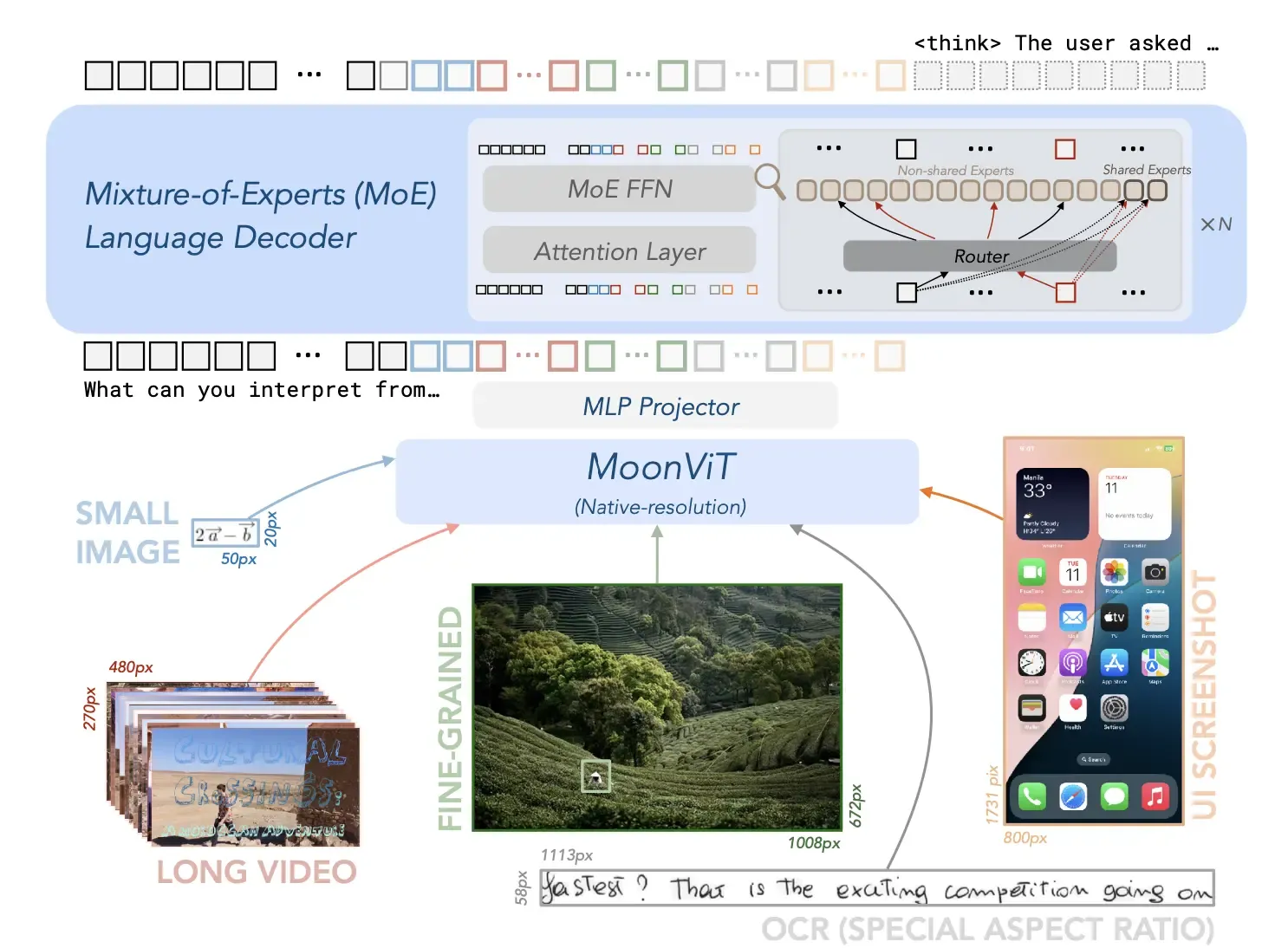

Kimi-VL是由月之暗面(MoonshotAI)团队开发的一款高效开源的多模态视觉语言模型(Vision-Language Model, VLM)。该模型采用了混合专家(Mixture-of-Experts, MoE)架构,旨在提供先进的多模态推理能力、长上下文理解能力和强大的代理(Agent)功能,同时保持较低的参数激活量。Kimi-VL在多个具有挑战性的领域表现出色,包括多轮代理交互任务、图像和视频理解、光学字符识别(OCR)、数学推理等。此外,项目团队还提供了多种模型变体,以满足不同场景下的需求。

二、功能特色

高效的多模态推理能力

Kimi-VL通过MoE架构实现了高效的多模态推理。该模型能够同时处理图像和文本数据,将它们映射到共同的语义空间中,并在此空间中进行推理和交互。这种能力使得Kimi-VL能够处理各种复杂的视觉语言任务,如图像描述、视频问答、跨模态检索等。

长上下文理解能力

Kimi-VL配备了128K的扩展上下文窗口,能够处理长且多样的输入。这一特性使得Kimi-VL在需要长上下文信息的任务中表现出色,如长视频理解、长文档问答等。此外,长上下文理解能力还有助于模型更好地理解和生成连贯的文本描述。

强大的代理功能

Kimi-VL不仅是一个多模态推理模型,还是一个强大的代理模型。它能够在与用户的交互中理解用户的意图和需求,并生成相应的响应和行动。这一特性使得Kimi-VL在智能客服、智能助手等场景中有着广泛的应用前景。

多种模型变体

项目团队提供了多种Kimi-VL的变体,以满足不同场景下的需求。例如,Kimi-VL-A3B-Instruct适用于一般的多模态感知和理解任务,以及OCR、长视频和长文档处理等任务;而Kimi-VL-A3B-Thinking则适用于需要高级文本和多模态推理的任务,如数学推理等。

易于使用的接口和工具

Kimi-VL提供了易于使用的接口和工具,使得开发者能够轻松地集成和使用该模型。例如,项目团队在Hugging Face上提供了Kimi-VL的Demo,用户可以通过网页界面与模型进行交互;同时,项目团队还提供了详细的文档和示例代码,帮助开发者更好地理解和使用Kimi-VL。

三、技术细节

MoE架构

Kimi-VL采用了MoE架构来提高模型的效率和可扩展性。MoE架构通过将模型分解为多个专家网络(Expert Networks)和门控网络(Gating Network),使得模型能够根据输入数据的不同部分选择性地激活不同的专家网络。这种机制有助于减少模型的计算量和参数量,同时保持模型的性能。

MoonViT视觉编码器

Kimi-VL采用了MoonViT作为视觉编码器。MoonViT是一种基于Transformer的视觉编码器,具有原生分辨率处理能力,能够处理超高分辨率的视觉输入。这一特性使得Kimi-VL在处理高分辨率图像和视频时表现出色。

MLP投影器

Kimi-VL采用了多层感知机(MLP)作为投影器,将视觉编码器和语言模型的输出映射到共同的语义空间中。这一机制有助于实现多模态数据的融合和推理。

长思考变体

Kimi-VL-Thinking是Kimi-VL的一个长思考变体,通过长链式思考(Chain-of-Thought, CoT)监督微调(Supervised Fine-Tuning, SFT)和强化学习(Reinforcement Learning, RL)来训练。这一变体在需要长时间推理和决策的任务中表现出色,如数学推理等。

支持多种输入形式

Kimi-VL支持多种输入形式,包括单图像、多图像、视频、长文档等。这使得Kimi-VL能够处理各种复杂的视觉语言任务。

四、应用场景

智能客服

Kimi-VL可以作为智能客服系统的核心模型,理解用户的意图和需求,并生成相应的响应和行动。例如,在金融、电商等领域,智能客服可以帮助用户解答问题、办理业务等。

智能助手

Kimi-VL可以作为智能助手的核心模型,帮助用户管理日程、提醒事项、发送邮件等。例如,在个人助手、办公助手等场景中,Kimi-VL可以根据用户的习惯和偏好提供个性化的服务。

跨模态检索

Kimi-VL可以用于跨模态检索任务,根据用户的文本查询返回相关的图像或视频结果。例如,在搜索引擎、图像库等场景中,Kimi-VL可以帮助用户快速找到所需的信息。

教育辅助

Kimi-VL可以用于教育辅助任务,帮助学生解答问题、解释概念等。例如,在在线教育、智能辅导等场景中,Kimi-VL可以根据学生的学习情况和需求提供个性化的教学服务。

科研辅助

Kimi-VL可以用于科研辅助任务,帮助研究人员处理和分析大量的图像和视频数据。例如,在生物医学、天文学等领域,Kimi-VL可以帮助研究人员快速提取关键信息、发现潜在规律等。

五、相关链接

Github地址:Kimi-VL GitHub仓库

Hugging Face Demo:Kimi-VL Hugging Face Demo

六、总结

Kimi-VL是一款高效开源的多模态视觉语言模型,具有先进的多模态推理能力、长上下文理解能力和强大的代理功能。通过采用MoE架构、MoonViT视觉编码器和MLP投影器等先进技术,Kimi-VL在处理各种复杂的视觉语言任务时表现出色。此外,项目团队还提供了多种模型变体、易于使用的接口和工具以及详细的文档和示例代码,使得开发者能够轻松地集成和使用该模型。在未来的发展中,我们期待Kimi-VL能够在更多领域发挥重要作用,为用户带来更加智能和便捷的服务体验。

本文由@ai资讯 原创发布。

该文章观点仅代表作者本人,不代表本站立场。本站不承担相关法律责任。

如若转载,请注明出处:https://www.zhanid.com/news/3993.html