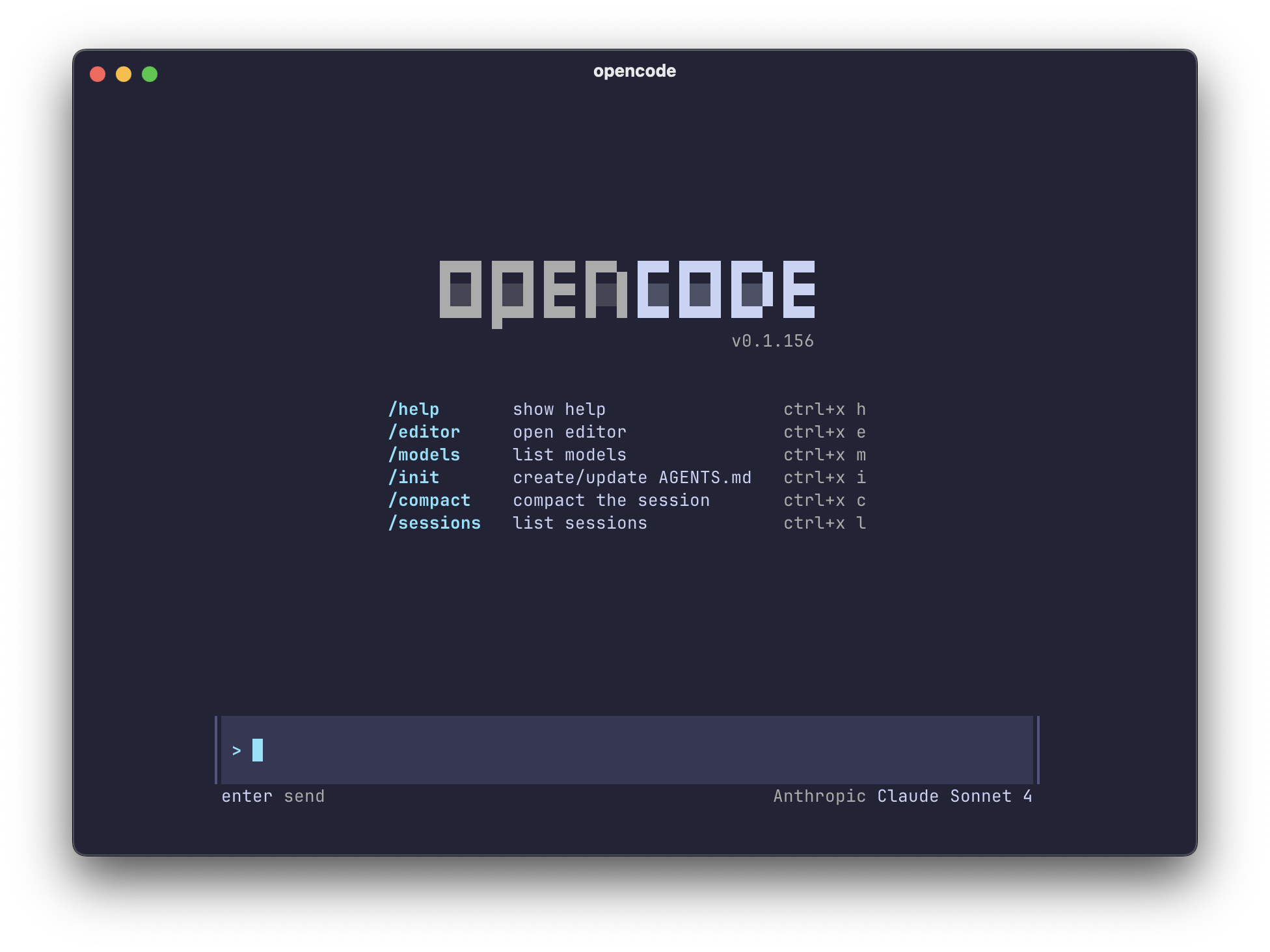

一、Crush是什么

Crush 是由 Charmbracelet 团队开发的开源终端工具,定位为 “面向开发者的AI编程工具”。它通过深度集成主流大语言模型(LLM),将自然语言交互、智能代码补全、上下文感知等能力融入终端环境,旨在 提升开发效率并降低复杂任务的学习成本。该项目基于 Rust 和 Go 语言 实现,支持跨平台运行(Windows/macOS/Linux/BSD),并提供丰富的扩展机制以适配不同开发场景。

1.1 核心目标

无缝衔接本地工具与云服务:通过 Model Context Protocol(MCP) 和 Language Server Protocol(LSP) 打通本地工具链与云端AI模型。

轻量化会话管理:支持多项目、多模型的上下文隔离,避免传统AI工具的数据混淆问题。

隐私与可控性:允许用户自定义API密钥、白名单工具调用及权限控制。

二、核心功能与特性

2.1 多模态AI集成

多模型兼容:原生支持 OpenAI、Anthropic、Groq、Azure OpenAI、Google Gemini 等主流LLM,支持通过 OpenAI/Anthropic兼容API 快速接入第三方模型。

动态切换模型:同一会话中可随时更换模型(如从GPT-4切换至Claude 3),且保留历史上下文。

成本控制:提供模型调用统计功能,显示每条消息的 token消耗与费用预估。

2.2 上下文感知与会话管理

多项目会话隔离:支持为不同项目创建独立工作区,自动保存代码片段、命令历史和模型回复。

持久化上下文:通过 SQLite数据库 存储会话数据,支持跨终端同步(需配合云存储扩展)。

代码片段回溯:可随时调用历史命令或代码块,支持模糊搜索与时间戳过滤。

2.3 LSP增强开发

智能代码补全:集成 gopls(Go)、typescript-language-server(TS/JS)、clangd(C/C++) 等主流LSP服务器,提供实时代码建议。

语义搜索:通过LSP查询符号定义、引用及类型信息,辅助快速导航大型代码库。

错误诊断:解析编译器输出,自动生成修复建议(如自动导入缺失模块)。

2.4 扩展性与自定义

MCP协议支持:通过 stdio/http/sse 三种协议对接自定义工具链,例如:

{

"mcp": {

"docker": {

"type": "stdio",

"command": "docker",

"env": {"DOCKER_HOST": "$(echo $DOCKER_HOST)"}

}

}

}工具白名单:预设安全策略,仅允许信任工具执行(如

git、curl),高危操作需手动授权。插件生态:支持通过 npm/yarn 安装社区开发的扩展插件(如代码格式化、部署工具集成)。

三、技术实现与架构

3.1 核心组件

命令解析器:采用 PEG语法解析器 处理用户输入,支持管道符(

|)、变量插值(${var})和异步任务调度。模型调度引擎:基于 Tokio异步运行时 实现并发请求管理,优化多模型混合调用的延迟问题。

存储层:使用 Sled嵌入式数据库 管理会话元数据,结合 Redis 实现跨设备同步(企业版功能)。

3.2 性能优化策略

缓存机制:对高频调用模型(如代码补全)的响应结果进行本地缓存,减少重复请求。

批处理优化:合并多个短请求为单次API调用(如批量生成测试用例)。

边缘计算:支持在本地设备运行轻量级模型(如TinyLlama),敏感任务无需暴露云端API。

四、安装与使用指南

4.1 快速安装

# macOS (Homebrew) brew install charmbracelet/tap/crush # Linux (Debian/Ubuntu) sudo apt install crush # Windows (PowerShell) iwr -useb https://github.com/charmbracelet/crush/releases/latest/download/crush_windows_amd64.exe | iex

4.2 基础交互示例

# 初始化新项目 crush init my-project # 调用GPT-4生成Python代码 crush code "写一个计算斐波那契数列的Python函数" # 查看最近5条会话记录 crush history --limit 5 # 在当前目录启动交互式调试会话 crush debug .

4.3 高级功能演示

多模型协同开发:

# 使用Claude分析需求文档 crush analyze --model claude-3-sonnet "需求文档内容..." # 切换至GPT-4生成技术方案 crush generate --model gpt-4 "技术方案要点..."

本地工具链集成:

# 调用Docker构建镜像 crush run docker "build -t my-app ." # 通过jq处理JSON数据 crush data "cat response.json | jq '.results[0].score'"

五、应用场景与案例

5.1 日常开发效率提升

代码生成:自动生成单元测试、REST API文档、SQL查询语句。

调试辅助:自动定位报错堆栈,推荐修复方案(如变量命名修正、语法纠错)。

文档查询:实时检索MDN/WebRTC文档,提供代码片段示例。

5.2 复杂任务编排

DevOps流程自动化:

# 一键部署到AWS EC2 crush deploy aws "创建EC2实例并部署最新镜像" # 监控告警处理 crush monitor "检测到CPU负载过高,触发扩容流程"

数据分析流水线:

# 从日志提取异常事件 crush extract "grep 'ERROR' app.log | parse-json" # 生成可视化图表 crush visualize "plot errors over time using Grafana"

5.3 团队协作与知识管理

内部文档问答:通过向量数据库(如Pinecone)实现团队知识库检索。

代码评审助手:自动检查PR中的潜在问题,提供改进建议。

会议纪要生成:实时转录语音并提取行动项,生成Markdown格式纪要。

六、竞品对比分析

| 特性 | Crush | GitHub Copilot | Tabnine |

|---|---|---|---|

| 模型灵活性 | 支持10+主流模型,可自定义API | 仅限OpenAI/GPT系列 | 依赖自研模型 |

| 上下文管理 | 多项目会话隔离,支持SQLite持久化 | 单会话上下文(约3k tokens) | 无显式会话管理 |

| 本地工具集成 | 深度集成LSP/SSH/MCP协议 | 依赖VSCode插件 | 仅限编辑器内补全 |

| 成本透明性 | 实时显示token消耗与费用预估 | 隐式计费 | 无详细用量统计 |

| 终端原生支持 | 全平台终端无缝嵌入 | 仅限IDE插件 | 仅限编辑器插件 |

七、相关链接

开源地址:https://github.com/charmbracelet/crush

八、总结

Crush通过 “终端即入口” 的理念,将AI能力深度整合到开发者日常工作中,解决了传统工具链的三大痛点:碎片化操作、上下文割裂、学习成本高。其核心优势在于:

低门槛交互:无需切换工具即可完成编码、调试、文档查询全流程。

强扩展性:通过MCP/LSP协议适配任意本地工具,保护既有投资。

透明可控:细粒度的权限管理与成本监控降低企业级应用风险。

随着LLM技术的持续演进,Crush有望成为下一代终端交互的标准范式,推动软件开发进入 “人机协同” 新时代。

本文由@ai资讯 原创发布。

该文章观点仅代表作者本人,不代表本站立场。本站不承担相关法律责任。

如若转载,请注明出处:https://www.zhanid.com/news/crush.html