HelloMeme是什么

HelloMeme是一款开源的面部表情与姿态迁移框架,它利用先进的AI技术,特别是基于最新的Diffusion生成技术,实现了将视频中的人物表情和姿态迁移到静态图像中,生成个性化、趣味十足的动态表情包。这一技术不仅为社交媒体内容创作带来了新的可能性,也为视频娱乐、游戏和电影制作等领域提供了强大的工具。HelloMeme集成了空间编织注意力(Spatial Knitting Attentions)机制,基于Stable Diffusion 1.5模型的理解能力,将头部姿态和面部表情信息融合到去噪网络中,生成自然且物理合理的表情包视频。

功能特色

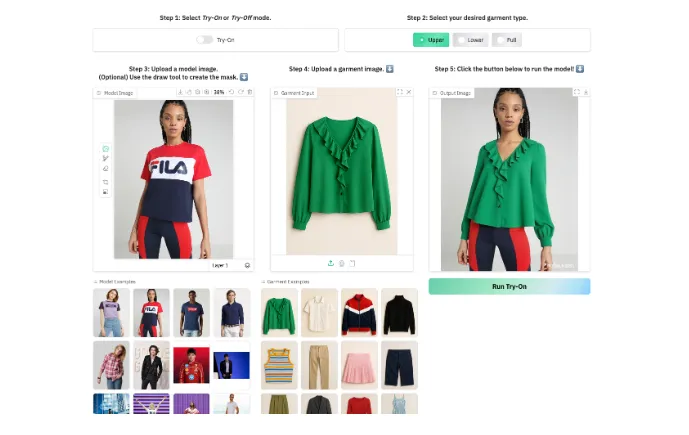

1. 表情与姿态迁移

HelloMeme的核心功能在于实现面部表情与姿态的迁移。它能够将驱动视频中的头部姿态和面部表情迁移到参考图像中,生成具有夸张表情和姿态的动态视频内容。这意味着,用户可以将任何静态照片变成动态的表情包,让人物“活”起来。例如,用户可以将自己的照片与一段有趣的视频相结合,生成一个具有自己面部特征和视频中人物表情的动态视频,从而增加内容的趣味性和互动性。

2. 保持泛化能力

HelloMeme在执行复杂的下游任务时,能够保持基础模型的泛化能力。这意味着它不仅能够处理特定的表情和姿态迁移任务,还能够生成多样化的内容,不局限于特定任务。这种泛化能力使得HelloMeme能够适应不同的应用场景和用户需求,提供更加丰富和多样的内容创作体验。

3. 兼容性与扩展性

HelloMeme与SD1.5衍生模型具有良好的兼容性,并有潜力扩展到全身或半身构图的应用。这为未来的功能扩展提供了无限可能。用户可以根据实际需求,对HelloMeme进行定制和优化,以满足更加复杂和多样的内容创作需求。

4. 高质量视频生成

为了提高视频帧之间的连续性,HelloMeme采用两阶段生成流程。它先粗略生成视频帧,再通过再噪声化和运动模块生成平滑的视频片段。这种生成流程确保了生成的视频具有高质量和流畅性,为用户提供了更加真实和自然的视觉体验。

技术细节

1. 空间编织注意力机制

HelloMeme采用空间编织注意力(Spatial Knitting Attentions)机制,优化2D特征图的注意力操作。它先进行行注意力操作,再进行列注意力操作,从而保持2D特征图的空间结构信息。这种机制类似于纺织时经纬线的交织,能够更好地保留图像的空间特征。空间编织注意力机制提高了表情和姿态迁移的准确性,使得生成的动态视频更加自然和逼真。

2. 模块化设计

HelloMeme采用模块化设计,由三个主要模块组成:

HMReferenceNet:用于从参考图像中提取细节丰富的特征。

HMControlNet:负责编码头部姿态和面部表情信息。

HMDenoisingNet:接收前两个模块的特征,实现可控的去噪生成。

这种模块化的设计使得HelloMeme具有高度的灵活性和可扩展性,可以根据不同的需求进行定制。

3. 解耦控制信息

HelloMeme将头部姿态和面部表情信息解耦,分别编码,然后用SKCrossAttention机制融合。这提高了信息的表达能力,并减少了身份信息泄露的风险。解耦控制信息使得HelloMeme能够更准确地迁移表情和姿态,同时保持生成内容的真实性和安全性。

4. 两阶段生成流程

为了提高视频帧之间的连续性,HelloMeme采用两阶段生成流程。它先粗略生成视频帧,再通过再噪声化和运动模块生成平滑的视频片段。这种生成流程确保了生成的视频具有高质量和流畅性,为用户提供了更加真实和自然的视觉体验。

应用场景

1. 社交媒体内容创作

HelloMeme可以帮助用户快速生成个性化的表情包,丰富社交媒体内容,增加用户互动。用户可以将自己的照片变成动态表情包,在聊天、评论等场景中表达情感。这种个性化的表情包不仅能够吸引用户的注意力,还能够提升用户的参与度和活跃度。

2. 视频娱乐与游戏

HelloMeme可以用于生成各种有趣的视频内容,例如将人物的表情和姿态迁移到游戏角色中,增加游戏的趣味性。这种技术的应用可以使得游戏角色更加生动和逼真,提升玩家的游戏体验。同时,它也可以用于生成游戏宣传视频和广告,吸引更多的玩家关注和参与。

3. 电影制作

HelloMeme可以用于辅助电影制作,例如快速生成人物表情和姿态的动态效果,提高制作效率。在电影制作过程中,演员的表情和姿态是非常重要的元素。通过HelloMeme技术,可以将演员的表情和姿态迁移到静态图像或动画模型中,生成逼真的动态效果。这不仅可以节省制作时间和成本,还可以提高电影的质量和观赏性。

4. 教育与培训

HelloMeme可以用于生成生动的教学内容,例如将人物的表情和姿态迁移到教学视频中,提高学习效果。通过动态的表情包和视频,可以使得教学内容更加生动和有趣,吸引学生的注意力。同时,它也可以用于生成虚拟实验和模拟场景,帮助学生更好地理解和掌握知识点。

5. 广告与营销

HelloMeme可以用于生成创意广告内容,例如将品牌代言人的表情和姿态迁移到广告视频中,吸引用户关注。这种技术的应用可以使得广告内容更加生动和有趣,提升用户的参与度和记忆度。同时,它也可以用于生成虚拟形象和代言人,为品牌推广和营销提供新的思路和方法。

相关链接

GitHub仓库:https://github.com/HelloVision/HelloMeme

技术论文:https://arxiv.org/pdf/2410.22901

在线体验Demo:https://www.modelscope.cn/studios/songkey/HelloMeme

总结

HelloMeme是一款功能强大且灵活的面部表情与姿态迁移框架。它利用先进的AI技术,特别是基于最新的Diffusion生成技术,实现了将视频中的人物表情和姿态迁移到静态图像中,生成个性化、趣味十足的动态表情包。HelloMeme不仅具有高度的灵活性和可扩展性,还保持了基础模型的泛化能力,能够生成多样化的内容。它的应用场景广泛,包括社交媒体内容创作、视频娱乐与游戏、电影制作等多个领域。随着技术的不断进步和应用的不断拓展,我们有理由相信HelloMeme将在未来发挥更大的作用,推动人工智能技术在各个领域的应用和发展。

本文由@ai资讯 原创发布。

该文章观点仅代表作者本人,不代表本站立场。本站不承担相关法律责任。

如若转载,请注明出处:https://www.zhanid.com/news/2960.html