一、AudioGen-Omni是什么

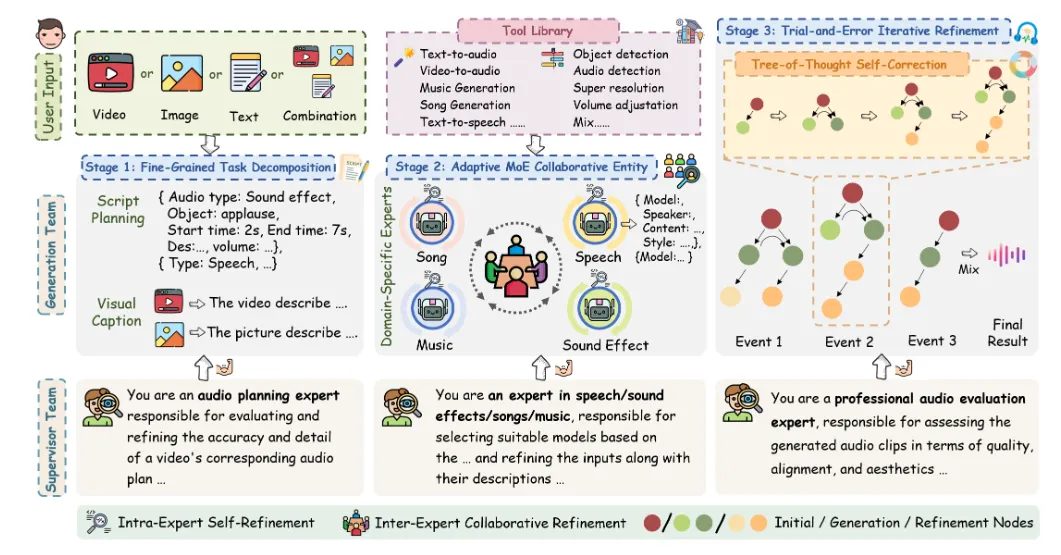

AudioGen-Omni 是一个多模态音频生成与编辑框架,旨在为用户提供一站式音频内容创作解决方案。该项目基于先进的深度学习技术构建,能够实现多种音频生成任务,包括但不限于音乐生成、语音合成、音效设计等。作为一个综合性音频处理平台,AudioGen-Omni整合了多种音频生成模型和工具,为用户提供了灵活、高效的音频创作体验。

该项目采用模块化设计,支持多种音频生成任务的扩展和定制,无论是专业音频工程师还是普通音乐爱好者,都能通过AudioGen-Omni轻松实现高质量的音频内容创作。其开源特性使得研究人员和开发者可以自由访问、修改和扩展系统功能,促进了音频生成技术的共享与创新。

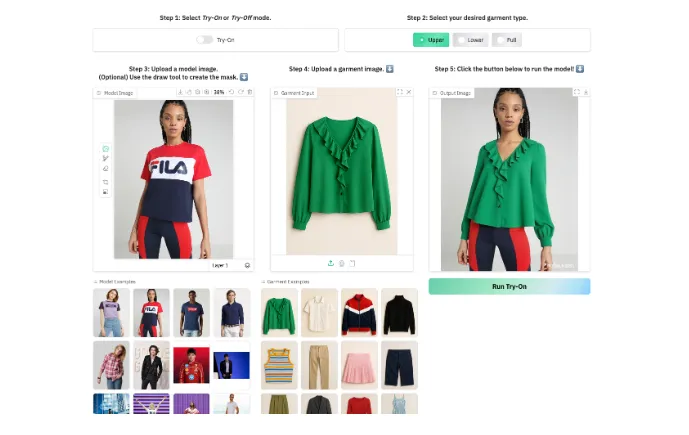

AudioGen-Omni特别注重用户体验,提供了直观的界面和丰富的API接口,支持从简单的文本到音频转换到复杂的多轨音频合成等多种应用场景。

二、功能特色

1. 多模态音频生成能力

AudioGen-Omni的核心优势在于其多模态的音频生成能力。系统支持基于文本、图像、MIDI等多种输入形式的音频生成:

文本到音频(TTA):用户只需输入描述性文本,系统即可生成符合描述的音频内容,如"欢快的钢琴曲"或"雨声和雷声的混合"。

图像到音频(ITA):系统能够分析图像内容并生成与之匹配的音频,如根据风景照片生成自然环境音效。

MIDI到音频:支持将MIDI文件转换为高质量的音乐音频,提供多种乐器音色选择。

这种多模态输入支持极大地扩展了音频创作的可能性,使非专业用户也能轻松参与音频内容创作。

2. 高质量音频输出

AudioGen-Omni采用先进的神经网络架构,能够生成采样率高、保真度优秀的音频输出:

支持最高96kHz的采样率输出,满足专业音频制作需求

提供多种音频格式输出选项,包括WAV、MP3、FLAC等

内置音频后处理模块,可自动优化生成音频的动态范围和频谱平衡

系统特别注重减少常见的人工合成痕迹,如机械音、爆音等,确保输出音频的自然流畅。

3. 实时交互式编辑

不同于传统的批量生成工具,AudioGen-Omni提供了实时交互式编辑功能:

参数实时调整:用户可以在音频生成过程中动态调整各种参数,并即时听到效果变化

多轨编辑:支持同时生成和编辑多个音频轨道,并实时混音

历史记录与撤销:完整记录操作历史,支持多步撤销和重做

这些交互功能大大提高了音频创作的灵活性和效率,特别适合音乐制作和音效设计场景。

4. 风格迁移与混合

AudioGen-Omni内置强大的风格迁移算法,用户可以:

将一种音乐风格应用到另一段音频上,如将古典乐转换为电子乐风格

混合多种风格特征,创造独特的音频效果

提取参考音频的声学特征并应用到新生成的音频中

这一功能为音乐创作和声音设计提供了无限可能性,用户可以轻松探索各种创意组合。

5. 扩展性与定制化

项目采用模块化设计,支持功能扩展和定制:

插件系统:开发者可以编写自定义插件来扩展系统功能

模型替换:支持替换或添加新的生成模型,适应特定领域需求

参数配置:提供详细的配置选项,可精细调整系统行为

这种开放性设计使得AudioGen-Omni能够适应从学术研究到商业应用的各种场景需求。

三、技术细节

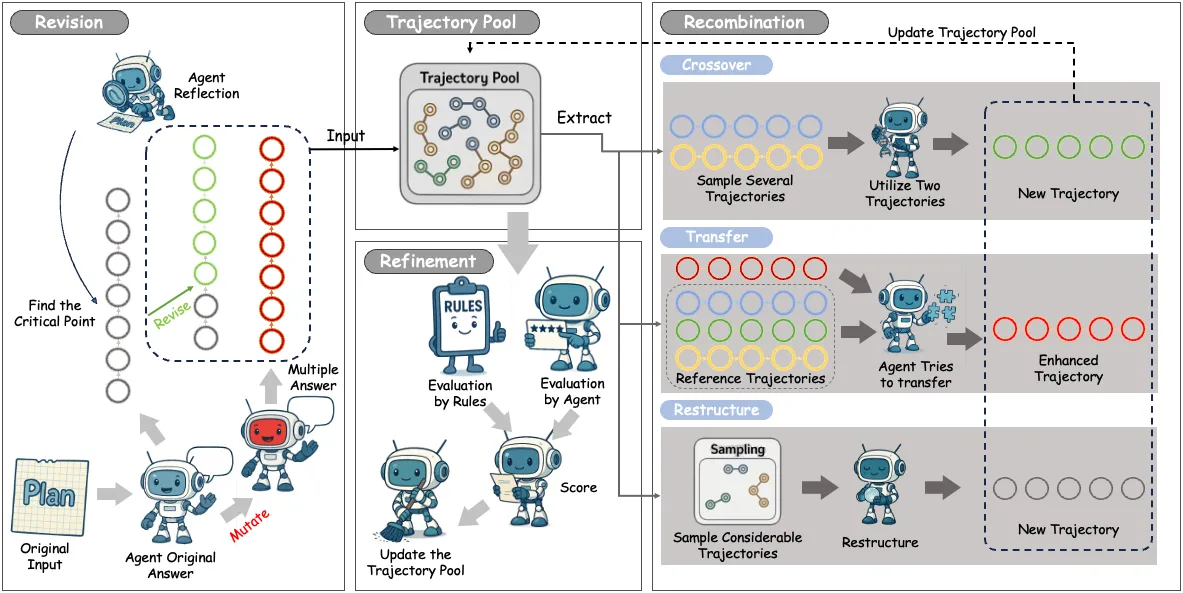

1. 核心架构

AudioGen-Omni采用分层架构设计,主要包含以下组件:

输入解析层:负责处理各种格式的输入数据(文本、图像、MIDI等),并将其转换为统一的中间表示。

特征提取层:使用预训练模型(如CLAP、ViT等)从输入数据中提取高级语义特征。

生成模型层:核心的音频生成组件,目前主要基于扩散模型和Transformer架构。

后处理层:对生成的音频进行降噪、均衡等处理,提升输出质量。

用户界面层:提供图形界面和API两种交互方式。

2. 关键算法

项目采用了多种先进的深度学习算法来实现其功能:

音频生成模型:基于类似AudioGen、MusicGen的架构,使用条件扩散模型生成高质量音频

跨模态对齐:采用对比学习技术(如CLIP-style训练)实现文本、图像与音频的语义对齐

风格迁移:基于特征解耦和重加权的方法实现内容与风格的分离与重组

实时处理:使用轻量级模型和高效的推理优化技术实现低延迟生成

3. 训练数据与方法

AudioGen-Omni的模型训练采用了大规模多模态数据集:

音频数据集:包括音乐(如Free Music Archive)、环境音(如AudioSet)、语音(如LibriSpeech)等

文本-音频对:使用自动标注和人工标注相结合的方式构建

图像-音频对:从视频数据中提取,并经过严格的质量筛选

训练过程采用多阶段策略:

预训练阶段:在大规模通用数据上训练基础模型

微调阶段:在特定领域数据上进行针对性优化

蒸馏阶段:生成轻量级模型用于实时应用

4. 性能优化

为确保系统的高效运行,项目采用了多种优化技术:

模型量化:使用8位整数量化减小模型大小

缓存机制:缓存常用计算结果,减少重复计算

并行处理:利用GPU加速和批处理提高吞吐量

自适应分辨率:根据用户需求动态调整生成音频的细节级别

这些优化使得系统即使在普通硬件上也能保持流畅运行。

四、应用场景

1. 音乐创作与制作

AudioGen-Omni为音乐人提供了强大的创作工具:

灵感激发:通过输入文字描述快速生成音乐创意

伴奏生成:为歌曲自动生成匹配的伴奏轨道

风格探索:轻松尝试不同音乐风格的组合与变化

编曲辅助:自动补全或丰富音乐编排

2. 游戏与影视音效设计

在游戏和影视制作领域,系统可以:

根据场景描述自动生成环境音效

为特定动作或事件创建匹配的声音效果

快速生成大量变体音效供选择

实现动态音效的实时生成与混合

3. 播客与视频制作

内容创作者可以利用AudioGen-Omni:

为视频自动生成背景音乐

创建独特的音效和转场声音

生成旁白或解说语音

优化和增强已有音频素材

4. 教育与研究

在学术和教育领域,项目可用于:

音乐教育中的范例生成

音频心理学实验材料制作

人工智能与创意计算研究

跨模态感知研究的数据生成

5. 辅助技术与无障碍应用

系统还适用于:

为视障用户生成环境描述音频

创建个性化的声音提示和警报

开发语音辅助应用程序

生成治疗性声音环境

五、相关链接

项目主页:https://ciyou2.github.io/AudioGen-Omni/

六、总结

AudioGen-Omni是一个功能强大、设计灵活的开源音频生成与编辑框架,它通过整合先进的深度学习技术和用户友好的交互设计,为各类音频创作需求提供了一站式解决方案。项目支持多模态输入、高质量音频生成、实时交互编辑和风格迁移等特色功能,可广泛应用于音乐制作、音效设计、内容创作等多个领域。AudioGen-Omni致力于降低音频生成技术的使用门槛,推动创意音频应用的普及与发展。

本文由@ai资讯 原创发布。

该文章观点仅代表作者本人,不代表本站立场。本站不承担相关法律责任。

如若转载,请注明出处:https://www.zhanid.com/news/audiogen-omni.html